K

Это незавершённая статья из области эвентологии и её применений, редактируемая при участии Мастера

Энтропи́я в теории информации — мера хаотичности информации, неопределённость появления какого-либо символа первичного алфавита. При отсутствии информационных потерь численно равна количеству информации на символ передаваемого сообщения.

Так, возьмём, например, последовательность символов, составляющих какое-либо предложение на русском языке. Каждый символ появляется с разной частотой, следовательно, неопределённость появления для некоторых символов больше, чем для других. Если же учесть, что некоторые сочетания символов встречаются очень редко, то неопределённость ещё более уменьшается (в этом случае говорят об энтропии n-ого порядка, см. Условная энтропия).

Концепции информации и энтропии имеют глубокие связи друг с другом, но, несмотря на это, разработка теорий в статистической механике и теории информации заняла много лет, чтобы сделать их соответствующими друг другу. Ср. тж. Термодинамическая энтропия

Формальные определения [ править ]

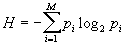

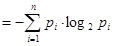

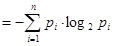

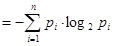

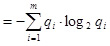

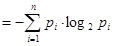

Энтропия независимых случайных событий x с n возможными состояниями (от 1 до n) рассчитывается по формуле:

Эта величина также называется средней энтропией сообщения. Величина называется частной энтропией, характеризующей только i-e состояние.

Таким образом, энтропия события x является суммой с противоположным знаком всех произведений относительных частот появления события i, умноженных на их же двоичные логарифмы (основание 2 выбрано только для удобства работы с информацией, представленной в двоичной форме). Это определение для дискретных случайных событий можно расширить для функции распределения вероятностей.

Шеннон вывел это определение энтропии из следующих предположений:

- мера должна быть непрерывной; т. е. изменение значения величины вероятности на малую величину должно вызывать малое результирующее изменение энтропии;

- в случае, когда все варианты (буквы в приведенном примере) равновероятны, увеличение количества вариантов (букв) должно всегда увеличивать полную энтропию;

- должна быть возможность сделать выбор (в нашем примере букв) в два шага, в которых энтропия конечного результата должна будет являтся суммой энтропий промежуточных результатов.

Шеннон показал, что любое определение энтропии, удовлетворяющее этим предположениям, должно быть в форме:

где K — константа (и в действительности нужна только для выбора единиц измерения).

Шеннон определил, что измерение энтропии (H = − p1 log2p1 − … − pn log2pn), применяемое к источнику информации, может определить требования к минимальной пропускной способности канала, требуемой для надежной передачи информации в виде закодированных двоичных чисел. Для вывода формулы Шеннона необходимо вычислить математическое ожидания «количества информации», содержащегося в цифре из источника информации. Мера энтропии Шеннона выражает неуверенность реализации случайной переменной. Таким образом, энтропия является разницей между информацией, содержащейся в сообщении, и той частью информации, которая точно известна (или хорошо предсказуема) в сообщении. Примером этого является избыточность языка — имеются явные статистические закономерности в появлении букв, пар последовательных букв, троек и т.д. См. Цепи Маркова.

В общем случае b-арная энтропия (где b равно 2,3. ) источника = (S,P) с исходным алфавитом S = a1, …, an> и дискретным распределением вероятности P = p1, …, pn> где pi является вероятностью ai (pi = p(ai)) определяется формулой:

Определение энтропии Шеннона очень связано с понятием термодинамической энтропии. Больцман и Гиббс проделали большую работу по статистической термодинамике, которая способствовала принятию слова «энтропия» в информационную теорию. Существует связь между понятиями энтропии в термодинамике и теории информации. Например, демон Максвелла также противопоставляет термодинамическую энтропию информации, и получение какого-либо количества информации равно потерянной энтропии.

Условная энтропия [ править ]

Если следование символов алфавита не независимо (например, во французском языке после буквы «q» почти всегда следует «u», а после слова «передовик» в советских газетах обычно следовало слово «производства» или «труда»), количество информации, которую несёт последовательность таких символов (а следовательно и энтропия) очевидно меньше. Для учёта таких фактов используется условная энтропия.

Условной энтропией первого порядка (аналогично для Марковской модели первого порядка) называется энтропия для алфавита, где известны вероятности появления одной буквы после другой (т.е. вероятности двухбуквенных сочетаний):

где — это состояние, зависящее от предшествующего символа, и — это вероятность , при условии, что был предыдущим символом.

Так, для русского алфавита без буквы «ё» .

Через частную и общую условные энтропии полностью описываются информационные потери при передаче данных в канале с помехами. Для этого применяются т.н. канальные матрицы. Так, для описания потерь со стороны источника (т.е. известен посланный сигнал), рассматривают условную вероятность получения приёмником символа при условии, что был отправлен символ . При этом канальная матрица имеет следующий вид:

| . | . | |||||

|---|---|---|---|---|---|---|

| . | . | |||||

| . | . | |||||

| . | . | . | . | . | . | . |

| . | . | |||||

| . | . | . | . | . | . | . |

| . | . |

Очевидно, вероятности, расположенные по диагонали описывают вероятность правильного приёма, а сумма всех элементов столбца даст вероятность появления соответствующего символа на стороне приёмника — . Потери, приходящиеся на предаваемый сигнал , описываются через частную условную энтропию:

Для вычисления потерь при передаче всех сигналов используется общая условная энтропия:

означает энтропию со стороны источника, аналогично рассматривается — энтропия со стороны приёмника: вместо всюду указывается (суммируя элементы строки можно получить , а элементы диагонали означают вероятность того, что был отправлен именно тот символ, который получен, т.е. вероятность правильной передачи).

Взаимная энтропия [ править ]

Взаимная энтропия, или энтропия объединения, предназначена для рассчёта энтропии взаимосвязанных систем (энтропии совместного появления статистически зависимых сообщений) и обозначается , где , как всегда, характеризует передатчик, а — приёмник.

Взаимосязь переданных и полученных сигналов описывается вероятностями совместных событий , и для полного описания характеристик канала требуется только одна матрица:

| … | … | ||||

| … | … | ||||

| … | … | … | … | … | … |

| … | … | ||||

| … | … | … | … | … | … |

| … | … |

Для более общего случая, когда описывается не канал, а просто взаимодействующие системы, матрица необязательно должна быть квадратной. Очевидно, сумма всех элементов столбца с номером даст , сумма строки с номером есть , а сумма всех элементов матрицы равна 1. Совместная вероятность событий и вычисляется как произведение исходной и условной вероятности,

Условные вероятности производятся по формуле Байеса. Таким образом имеются все данные для вычисления энтропий источника и приёмника:

Взаимная энтропия вычисляется последовательным суммированием по строкам (или по столбцам) всех вероятностей матрицы, умноженных на их логарифм:

Единица измерения — бит/два символа, это объясняется тем, что взаимная энтропия описывает неопределённость на пару символов — отправленного и полученного. Путём несложных преобразований также получаем

Взаимная энтропия обладает свойством информационной полноты — из неё можно получить все рассматриваемые величины.

Свойства [ править ]

Важно помнить, что энтропия является количеством, определённым в контексте вероятностной модели для источника данных. Например, кидание монеты имеет энтропию бита на одно кидание (при условии его независимости). У источника, который генерирует строку, состоящую только из букв «А», энтропия равна нулю: . Так, к примеру, опытным путём можно установить, что энтропия английского текста равна 1,5 бит на символ, что конечно будет варьироваться для разных текстов. Степень энтропии источника данных означает среднее число битов на элемент данных, требуемых для её зашифровки без потери информации, при оптимальном кодировании.

- Некоторые биты данных могут не нести информации. Например, структуры данных часто хранят избыточную информацию, или имеют идентичные секции независимо от информации в структуре данных.

- Количество энтропии не всегда выражается целым числом бит.

Альтернативное определение [ править ]

Другим способом определения функции энтропии H является доказательство, что H однозначно определена (как указано ранее), если и только если H удовлетворяет пунктам 1)—3):

1) H(p1, …, pn) определена и непрерывна для всех p1, …, pn, где pi [0,1] для всех i = 1, …, n и p1 + … + pn = 1. (Заметьте, что эта функция зависит только от распределения вероятностей, а не от алфавита.)

2) Для целых положительных n, должно выполняться следующее неравенство:

3) Для целых положительных bi, где b1 + … + bn = n, должно выполняться равенство:

Эффективность [ править ]

Исходный алфавит, встречающийся на практике, имеет вероятностное распределение, которое далеко от оптимального. Если исходный алфавит имел n символов, тогда он может может быть сравнён с «оптимизированным алфавитом», вероятностное распределение которого однородно. Соотношение энтропии исходного и оптимизированного алфавита — это эффективность исходного алфавита, которая может быть выражена в процентах.

Из этого следует, что эффективность исходного алфавита с n символами может быть определена просто как равная его n-арной энтропии.

Энтропия ограничивает максимально возможное сжатие без потерь (или почти без потерь), которое может быть реализовано при использовании теоретически — типичного набора или, на практике, — кодирования Хаффмана, кодирования Лемпеля-Зива или арифметического кодирования.

История [ править ]

В 1948 году, исследуя проблему рациональной передачи информации через зашумленный коммуникационный канал, Клод Шеннон предложил революционный вероятностный подход к пониманию коммуникаций и создал первую, истинно математическую, теорию энтропии. Его сенсационные идеи быстро послужили основой разработки двух основных направлений: теории информации, которая использует понятие вероятности и эргодическую теорию для изучения статистических характеристик данных и коммуникационных систем, и теории кодирования, в которой используются главным образом алгебраические и геометрические инструменты для разработки эффективных шифров.

Понятие энтропии, как меры случайности, введено Шенноном в его статье «A Mathematical Theory of Communication», опубликованной в двух частях в Bell System Technical Journal в 1948 году.

3. Понятие информационной энтропии.

Энтропи́я (информационная) — мера хаотичности информации, неопределённость появления какого-либо символа первичного алфавита. При отсутствии информационных потерь численно равна количеству информации на символ передаваемого сообщения.

Так, возьмём, например, последовательность символов, составляющих какое-либо предложение на русском языке. Каждый символ появляется с разной частотой, следовательно, неопределённость появления для некоторых символов больше, чем для других. Если же учесть, что некоторые сочетания символов встречаются очень редко, то неопределённость ещё более уменьшается .

Концепции информации и энтропии имеют глубокие связи друг с другом, но, несмотря на это, разработка теорий в статистической механике и теории информации заняла много лет, чтобы сделать их соответствующими друг другу.

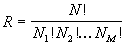

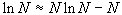

Введение понятия энтропии основывается на использовании вероятностной меры различных опытов. Для получения формулы информационной энтропии можно использовать следующий прием. Пусть имеется последовательность из N событий (например, текст из N букв), каждое из которых принимает одно из M состояний (M ¾ количество букв в алфавите). Тогда

В дальнейшем понятие энтропии можно применить для решения задач по вычислению неопределенности (а значит и информационной нагрузки) различных опытов. Если полученная информация полностью снимает неопределенность опыта, то ее количество считается равным энтропии данного опыта. Следовательно, использование понятия энтропии может служить для определения ценности различных прогнозов. И еще более интересно и полезно использование понятия энтропии (с практической точки зрения) для установления критерия оценки эффективности реального кода и в качестве инструмента разработки экономных кодов.

5. Основные понятия базовых информационных процессов: хранения, передачи обработки информации.

Информационный процесс — процесс получения, создания, сбора, обработки, накопления, хранения, поиска, передачи и использования информации.

Какой бы информационной деятельностью люди не занимались, вся она сводится к осуществлению трех процессов: хранению, передаче и обработке информации. Эти процессы называются базовыми.

Под хранением информации следует понимать содержание информации во внешней памяти компьютера.

С хранением информации связаны такие понятия, как носитель информации, внутренняя память, внешняя память, хранилище информации. Носитель информации – это физическая среда, непосредственно хранящая информацию. Основным носителем информации для человека является его собственная биологическая память (мозг человека). Ее можно назвать внутренней памятью. Все прочие виды носителей информации можно назвать внешними (по отношению к человеку).

Хранилище информации – это определенным образом организованная совокупность данных на внешних носителях, предназначенная для длительного хранения и постоянного использования. Примерами хранилищ являются архивы документов, библиотеки, справочники, картотеки. Основной информационной единицей хранилища является определенный физический документ – анкета, книга, дело, досье, отчет и пр. Под организацией хранилища понимается наличие определенной структуры, т.е. упорядоченность, классификация хранимых документов. Такая организация необходима для удобства ведения хранилища: пополнения его новыми документами, удаления ненужных документов, поиска информации и пр.

Основные свойства хранилища информации – объем хранимой информации, надежность хранения, время доступа, наличие защиты информации.

Информацию, хранимую на устройствах компьютерной памяти, принято называть данными. Организованные хранилища данных на устройствах внешней памяти компьютера принято называть базами данных.

В современных компьютерах основными носителями информации для внешней памяти служат магнитные и оптические диски.

Единицы хранения данных. При хранении данных решаются две проблемы: как сохранить данные в наиболее компактном виде и как обеспечить к ним удобный и быстрый доступ. Для обеспечения доступа необходимо, чтобы данные имели упорядоченную структуру, а при этом возникает необходимость дополнительно записывать адресные данные. Без них нельзя получить доступ к нужным элементам данных, входящих в структуру .

Поскольку адресные данные тоже имеют размер и тоже подлежат хранению, хранить данные в виде мелких единиц, таких, как байты, неудобно. Их неудобно хранить и в более крупных единицах (килобайтах, мегабайтах и т.п.), поскольку неполное заполнение одной единицы хранения приводит к неэффективности хранения.

В качестве единицы хранения данных принят объект переменной длины, называемый файлом. Файл – это последовательность произвольного числа байтов, обладающая уникальным собственным именем. Обычно в отдельном файле хранят данные, относящиеся к одному типу. В этом случае тип данных определяет тип файла.

Процесс транспортирования информации рассматривается в рамках эталонной семиуровневой модели, известной как модель OSI (Open System Intercongtion- связь открытых систем). Большое внимание уделено протоколам различных уровней, обеспечивающих необходимый уровень стандартизации:

1. Нижний уровень (канальный и физический уровни OSI, например NDIS, ODI)

2. Средний уровень ( сетевой, транспортный и сеансовый уровни OSI, например сеансовые и дейтаграммные протоколы)

3. Верхний уровень (уровень представления и прикладной уровень OSI)

Физический уровень реализует физическое управление и относится к физической цепи, например телефонной, по которой передается информация. На этом уровне модель OSI определяет физические, электрические, функциональные и процедурные характеристики цепей связи, а также требования к сетевым адаптерам и модемам.

Канальный уровень. На этом уровне осуществляется управление звеном сети (каналом) и реализуется пересылка блоков (совокупности битов) информации по физическому звену. Осуществляет такие процедуры управления, как определение начала и конца блока, обнаружение ошибок передачи, адресация сообщений и др

Сетевой уровень относится к виртуальной (воображаемой) цепи, которая не обязана существовать физически. Программные средства данного уровня обеспечивают определение маршрута передачи пакетов в сети. Маршрутизаторы, обеспечивающие поиск оптимального маршрута на основе анализа адресной информации, функционируют на сетевом уровне модели OSI, называемое мостом.

Транспортный уровень. На транспортном уровне контролируется очередность пакетов сообщений и их принадлежность. Таким образом, в процессе обмена между компьютерами поддерживается виртуальная связь, аналогичная телефонной коммутации.

Сеансовый уровень. На данном уровне координируются и стандартизируются процессы установления сеанса, управления передачей и приемом пакетов сообщений, завершения сеанса. Программные средства этого уровня выполняют преобразования данных из внутреннего формата передающего компьютера во внутренний формат компьютера-получателя, если эти форматы отличаются друг от друга. Помимо конвертирования форматов на данном уровне осуществляется сжатие передаваемых данных и их распаковка.

Прикладной уровень относится к функциям, которые обеспечивают поддержку пользователю на более высоком прикладном и системном уровнях, например: организация доступа к общим сетевым ресурсам: информации, дисковой памяти, программным приложениям, внешним устройствам (принтерам, стримерам и др.); общее управление сетью (управление конфигурацией, разграничение доступа к общим ресурсам сети, восстановление работоспособности после сбоев и отказов, управление производительностью); передача электронных сообщений.

Под обработкой информации понимают ее преобразование с целью подготовки к практическому использованию. Иногда обработка информации определяется как оперирование данными по определенным правилам.

В процессе обработки информации всегда решается некоторая информационная задача, заключающаяся в получении итоговой информацию на основании исходных данных. Процесс перехода от исходных данных к результату и представляет собой обработку информации. Субъект, осуществляющий обработку, является исполнителем обработки. Исполнитель может быть человеком, а может быть специальным техническим устройством, в том числе компьютером.

Обычно обработка информации – это целенаправленный процесс. Для успешного выполнения обработки информации исполнителю должен быть известен способ обработки, т.е. последовательность действий, которую нужно выполнить, чтобы достичь нужного результата. Описание такой последовательности действий в информатике принято называть алгоритмом обработки.

Обычно различают два типа ситуаций, связанных с обработкой информации.

Первый тип – обработка, связанная с получением нового содержания знаний. К этому типу обработки относится решение математических задач. Способ обработки, т.е. алгоритм решения задачи, определяется математическими формулами, которые известны исполнителю. К этому типу обработки информации относится решение различных задач путем применения логических рассуждений.

Второй тип – обработка, связанная с изменением формы, но не изменяющая содержания. К этому типу обработки информации относится, например, перевод текста с одного языка на другой. Изменяется форма, но должно сохраниться содержание. Важным видом обработки для информатики является кодирование. Кодирование – это преобразование информации в символьную форму, удобную для ее хранения, передачи, обработки. Кодирование активно используется в технических средствах работы с информацией (телеграф, радио, компьютеры).

К обработке информации относится структурирование данных. Структурирование связано с внесением определенного порядка, определенной организации в хранилище информации. Примерами структурирования могут служить расположение данных в алфавитном порядке, группировка по некоторым признакам классификации, использование табличного представления.

Еще один важный вид обработки информации – поиск. Задача поиска состоит в отборе нужной информации, удовлетворяющей определенным условиям поиска, в имеющемся хранилище информации. Алгоритм поиска зависит от способа организации информации. Если информация структурирована, то поиск осуществляется быстрее, можно построить оптимальный алгоритм.

Таким образом, в зависимости от цели при обработке информации может изменяться форма ее представления либо ее содержание. Процессы изменения формы представления информации часто сводятся к процессам ее кодирования и декодирования и проходят одновременно с процессами сбора и передачи информации. Процесс изменения содержания информации включает в себя такие процедуры, как численные расчеты, редактирование, упорядочивание, обобщение, систематизация и т.д. Если правила преобразования информации строго формализованы и имеется алгоритм их реализации, то можно построить устройство для автоматизированной обработки информации.

Следует упомянуть неоднородность информационных ресурсов, характерную для многих предметных областей. Одним из путей решения данной проблемы является объектно-ориентированный подход, наиболее распространенный в настоящее время. Кратко рассмотрим его основные положения. Декомпозиция на основе объектно-ориентированного подхода основана на выделении следующих основных понятий: объект, класс, экземпляр.

Объект — это абстракция множества предметов реального мира, обладающих одинаковыми характеристиками и законами поведения. Объект характеризует собой типичный неопределенный элемент такого множества. Основной характеристикой объекта является состав его атрибутов (свойств).

Атрибуты — это специальные объекты, посредством которых можно задать правила описания свойств других объектов.

Экземпляр объекта — это конкретный элемент множества. Например, объектом может являться государственный номер автомобиля, а экземпляром этого объекта — конкретный номер К 173 ПА.

Класс — это множество предметов реального мира, связанных общностью структуры и поведением. Элемент класса — это конкретный элемент данного множества. Например, класс регистрационных номеров автомобиля.

Информация передается в виде сигналов. Сигнал- физический процесс, несущий в себе информацию. Сигнал может быть звуковым, световым, в виде почтового отправления и др.

По видам (типам) сигналов выделяются следующие:

Аналоговый сигнал является естественным. Его можно зафиксировать с помощью различных видов датчиков. Например, датчиками среды (давление, влажность) или механическими датчиками (ускорение, скорость)

Цифровые сигналы являются искусственными, т.е. их можно получить только путем преобразования аналогового электрического сигнала.

Дискретный сигнал – это все тот же преобразованный аналоговый сигнал, только он необязательно квантован по уровню.

Дискретизация — преобразование непрерывной функции в дискретную.

Используется в гибридных вычислительных системах и цифровых устройствах при импульсно-кодовой модуляции сигналов в системах передачи данных [1] . При передаче изображения используют для преобразования непрерывного аналогового сигнала в дискретный или дискретно-непрерывный сигнал.

7.Кодирование информации. Алфавит. Слово. Словарь. Двоичное кодирование.

1. Кодирование информации обычно применяется для преобразования сообщений из формы, удобной для непосредственного использования, в форму, удобную для передачи, хранения или автоматической переработки

Любая информация, с которой работает современная вычислительная техника, преобразуется в числа в двоичной системе счисления.

Дело в том, что физические устройства (регистры, ячейки памяти) могут находиться в двух состояниях, которым соотносят 0 или 1. Используя ряд подобных физических устройств, можно хранить в памяти компьютера почти любое число в двоичной системе счисления. Кодирование в компьютере целых чисел, дробных и отрицательных, а также символов (букв и др.) имеет свои особенности для каждого вида. Однако, всегда следует помнить, что любая информация (числовая, текстовая, графическая, звуковая и др.) в памяти компьютера представляется в виде чисел в двоичной системе счисления (почти всегда). В общем смысле кодирование информации можно определить как перевод информации, представленной сообщением в первичном алфавите, в последовательность кодов.

Обычно сообщения передаются и регистрируются с помощью некоторой последовательности символов — знаков.

Алфавит языка интерпретации сообщений – конечное множество входящих в него знаков, обычно задается их прямым перечислением. Конечная последовательность знаков алфавита называется словом в алфавите. Количество знаков в слове определяет длину слова. Множество различных допустимых слов образует словарный запас (словарь) алфавита. Любой алфавит имеет упорядоченный вид, знаки расположены последовательно в строгом порядке, таким образом, в словаре обеспечивается упорядочивание всех слов по алфавиту.

В качестве длины кода для кодирования символов было выбрано 8 бит или 1 байт. Поэтому одному символу текста соответствует один байт памяти.

Различных комбинаций из 0 и 1 при длине кода 8 бит может быть 28 = 256, поэтому с помощью одной таблицы перекодировки можно закодировать не более 256 символов. При длине кода в 2 байта (16 бит) можно закодировать 65536 символов. Для того чтобы закодировать один символ используют количество информации равное 1 байту, т. е. I = 1 байт = 8 бит. При помощи формулы, которая связывает между собой количество возможных событий К и количество информации I, можно вычислить сколько различных символов можно закодировать К = 2I = 28 = 256, т. е. для представления текстовой информации можно использовать алфавит мощностью 256 символов.

Суть кодирования заключается в том, что каждому символу ставят в соответствие двоичный код от 00000000 до 11111111 или соответствующий ему десятичный код от 0 до 255. Одному и тому же двоичному коду ставится в соответствие различные символы.

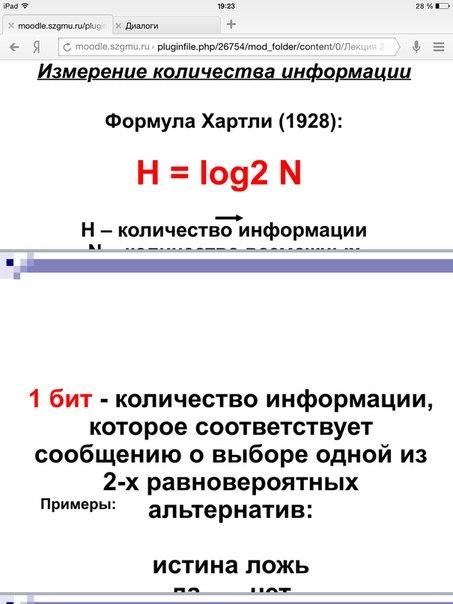

9. Количество информации. Мера количества информации и ее свойства. Формула Хартли.

Количество информации – число, адекватно характеризующее величину разнообразия (набор состояний, альтернатив и т.д.) в оцениваемой системе.

Мера информации – формула, критерий оценки количества информации.

Мера информации обычно задана некоторой неотрицательной функцией, определенной на множестве событий и являющейся аддитивной, то есть мера конечного объединения событий (множеств) равна сумме мер каждого события. Количество информации – число, адекватно характеризующее величину разнообразия (набор состояний, альтернатив и т.д.) в оцениваемой системе.

Означает термин энтропия точки зрения теории информатики

Окончание. Начало в №2, №3 2016

6. Энтропия Шеннона

Клод Шеннон первым начал интерпретировать передаваемые сообщения и шумы в каналах связи с точки зрения статистики, рассматривая как конечные, так и непрерывные множества сообщений. Клода Шеннона называют «отцом теории информации».

Одной из самых известных научных работ Клода Шеннона является его статья «Математическая теория связи», опубликованная в 1948 году.

В этой работе Шеннон, исследуя проблему рациональной передачи информации через зашумленный коммуникационный канал, предложил вероятностный подход к пониманию коммуникаций, создал первую, истинно математическую, теорию энтропии как меры случайности и ввёл меру дискретного распределения p вероятности на множестве альтернативных состояний передатчика и приёмника сообщений.

Шеннон задал требования к измерению энтропии и вывел формулу, ставшую основой количественной теории информации:

H (p)

Здесь n – число символов, из которых может быть составлено сообщение (алфавит), H – информационная двоичная энтропия.

На практике значения вероятностей pi в приведённой формуле заменяют их статистическими оценками: pi

Во введении к своей статье «Математическая теория связи» Шеннон отмечает, что в этой статье он расширяет теорию связи, основные положения которой содержатся в важных работах Найквиста и Хартли.

американский инженер шведского

происхождения, один из пионеров

теории информации

Первые результаты Найквиста по определению ширины частотного диапазона, требуемого для передачи информации, заложили основы для последующих успехов Клода Шеннона в разработке теории информации.

В 1928 году Хартли ввёл логарифмическую меру информации H = K · log2N, которую часто называют хартлиевским количеством информации.

Хартли принадлежит следующая важная теорема о необходимом количестве информации: если в заданном множестве M, состоящем из N элементов, содержится элемент x, о котором известно только то, что он принадлежит этому множеству M, то, чтобы найти x, необходимо получить об этом множестве количество информации, равное log2N бит.

Кстати, отметим, что название БИТ произошло от английской аббревиатуры BIT – BInary digiT. Этот термин впервые был предложен американским математиком Джоном Тьюки в 1946 году. Хартли и Шеннон использовали бит как единицу измерения информации.

Вообще, энтропия Шеннона – это энтропия множества вероятностей p1, p2,…, pn.

– американский учёный-электронщик

Строго говоря, если X – конечная дискретная случайная величина, а p1, p2,…, pn – вероятности всех её возможных значений, то функция H (X )

Аналогично, если Y – конечная дискретная случайная величина, а q1, q2,…, qm – вероятности всех её возможных значений, то для этой случайной величины можно записывать H (Y )

американский математик. Тьюки избрал

бит для обозначения одного разряда

в двоичной системе счисления

Шеннон назвал функцию H(X )

Нейман убеждал: эту функцию следует назвать энтропией «по двум причинам. В первую очередь, Ваша функция неопределённости была использована в статистической механике под этим именем, так что у неё уже есть имя. На втором месте, и что более важно, никто не знает, что такое энтропия на самом деле, так что в дискуссии Вы всегда будете иметь преимущество».

Надо полагать, что этот совет Неймана не был простой шуткой. Скорее всего, и Джон фон Нейман и Клод Шеннон знали об информационной интерпретации энтропии Больцмана как о величине, характеризующей неполноту информации о системе.

В определении Шеннона энтропия – это количество информации, приходящейся на одно элементарное сообщение источника, вырабатывающего статистически независимые сообщения.

7. Энтропия Колмогорова

А.Н. Колмогоровым были получены фундаментальные результаты во многих областях математики, в том числе в теории сложности алгоритмов и теории информации.

В частности, ему принадлежит ключевая роль в превращении теории информации, сформулированной Клодом Шенноном как технической дисциплины, в строгую математическую науку, и в построении теории информации на принципиально иной, отличной от шенноновской, основе.

В своих работах по теории информации и в области теории динамических систем А.Н. Колмогоров обобщил понятие энтропии на эргодические случайные процессы через предельное распределение вероятностей. Чтобы понять смысл этого обобщения, необходимо знать основные определения и понятия теории случайных процессов.

Значение энтропии Колмогорова (еще называемой K-энтропией) задает оценку скорости потери информации и может интерпретироваться как мера «памяти» системы, или мера скорости «забывания» начальных условий. Её можно также рассматривать как меру хаотичности системы.

8. Энтропия Реньи

Альфред Реньи ввёл однопараметрический спектр энтропий Реньи.

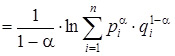

С одной стороны, энтропия Реньи представляет собой обобщение энтропии Шеннона. А с другой стороны, одновременно с этим она представляет собой обобщение расстояния (расхождения) Кульбака-Лейблера. Отметим также, что именно Реньи принадлежит полное доказательство теоремы Хартли о необходимом количестве информации.

Расстояние Кульбака-Лейблера (информационная дивергенция, относительная энтропия) – это несимметричная мера удалённости друг от друга двух вероятностных распределений.

Обычно одно из сравниваемых распределений является «истинным» распределением, а второе распределение – предполагаемым (проверяемым) распределением, являющимся приближением первого.

Пусть X, Y – это конечные дискретные случайные величины, для которых области возможных значений принадлежат заданному множеству и известны функции вероятности: P (X = ai) = pi и P (Y = ai) = qi.

Тогда значение DKL расстояния Кульбака-Лейблера вычисляется по формулам

DKL (X, Y ) =

В случае абсолютно непрерывных случайных величин X, Y, заданных своими плотностями распределения, в формулах для вычисления значения расстояния Кульбака-Лейблера суммы заменяются соответствующими интегралами.

Расстояние Кульбака-Лейблера всегда является неотрицательным числом, при этом оно равно нулю DKL(X, Y) = 0 тогда и только тогда, когда для заданных случайных величин почти всюду справедливо равенство X = Y.

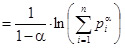

В 1960 году Альфред Реньи предлагает своё обобщение энтропии.

Энтропия Реньи представляет собой семейство функционалов для количественного разнообразия случайности системы. Реньи определил свою энтропию как момент порядка α меры ε-разбиения (покрытия).

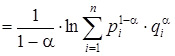

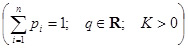

Пусть α – заданное действительное число, удовлетворяющее требованиям α ≥ 0, α ≠ 1. Тогда энтропия Реньи порядка α определяется формулой Hα = Hα (X )

В противном случае, значения энтропий Реньи слабо уменьшаются при возрастании значений параметра α. Энтропии Реньи играют важную роль в экологии и статистике как индексы разнообразия.

Энтропия Реньи также важна в квантовой информации, она может быть использована в качестве меры сложности.

Рассмотрим некоторые частные случаи энтропии Реньи для конкретных значений порядка α:

1. Энтропия Хартли: H = H (X ) = ln n, где n – мощность области возможных значений конечной случайной величины X, т.е. количество различных элементов, принадлежащих множеству возможных значений;

2. Информационная энтропия Шеннона: H1 = H1 (X ) = H1 (p)

3. Корреляционная энтропия или столкновение энтропии: H2 = H2 (X )

4. Min-энтропия: H∞ = H∞(X )

Альфред Реньи ввёл не только свои абсолютные энтропии (1.15), он определил также спектр мер расхождений, обобщающих расхождения Кульбака-Лейбнера.

Пусть α – заданное действительное число, удовлетворяющее требованиям α > 0, α ≠ 1. Тогда в обозначениях, использованных при определении значения DKL расстояния Кульбака-Лейблера, значение расхождения Реньи порядка α определяется формулами

Dα(X, Y )

Расхождение Реньи также называют alpha-расхождением или α-дивергенцией. Сам Реньи использовал логарифм по основанию 2, но, как всегда, значение основания логарифма абсолютно неважно.

9. Энтропия Тсаллиса

В 1988 году Константино Тсаллис предложил новое обобщение энтропии, являющееся удобным для применения с целью разработки теории нелинейной термодинамики.

Предложенное им обобщение энтропии, возможно, в ближайшем будущем сможет сыграть существенную роль в теоретической физике и астрофизике.

Энтропия Тсаллиса Sq, часто называемая неэкстенсивной (неаддитивной) энтропией, определяется для n микросостояний согласно следующей формуле:

Sq = Sq (X ) = Sq (p) = K·

Здесь K – размерная константа, если размерность играет важную роль для понимания задачи.

Тсаллис и его сторонники предлагают развивать «неэкстенсивную статистическую механику и термодинамику» в качестве обобщения этих классических дисциплин на случай систем с длинной памятью и/или дальнодействующими силами.

От всех других разновидностей энтропии, в т.ч. и от энтропии Реньи, энтропия Тсаллиса отличается тем, что не является аддитивной. Это принципиальное и важное отличие.

Тсаллис и его сторонники считают, что эта особенность даёт возможность построить новую термодинамику и новую статистическую теорию, которые способы просто и корректно описывать системы с длинной памятью и системы, в которых каждый элемент взаимодействует не только с ближайшими соседями, но и со всей системой в целом или её крупными частями.

Примером таких систем, а поэтому и возможным объектом исследований с помощью новой теории, являются космические гравитирующих системы: звёздные скопления, туманности, галактики, скопления галактик и т.п.

Начиная с 1988 года, когда Константино Тсаллис предложил свою энтропию, появилось значительное число приложений термодинамики аномальных систем (с длиной памятью и/или с дальнодействующими силами), в том числе и в области термодинамики гравитирующих систем.

10. Квантовая энтропия фон Неймана

Энтропия фон Неймана играет важную роль в квантовой физике и в астрофизических исследованиях.

Джон фон Нейман внёс значительный вклад в развитие таких отраслей науки, как квантовая физика, квантовая логика, функциональный анализ, теория множеств, информатика и экономика.

Он являлся участником Манхэттенского проекта по разработке ядерного оружия, одним из создателей математической теории игр и концепции клеточных автоматов, а также основоположником современной архитектуры компьютеров.

Энтропия фон Неймана, как всякая энтропия, связана с информацией: в данном случае – с информацией о квантовой системе. И в этом плане она играет роль фундаментального параметра, количественно характеризующего состояние и направление эволюции квантовой системы.

В настоящее время энтропия фон Неймана широко используется в различных формах (условная энтропия, относительная энтропия и т.д.) в рамках квантовой теории информации.

Различные меры запутанности непосредственно связаны с энтропией фон Неймана. Тем не менее, в последнее время появился ряд работ, посвящённых критике энтропии Шеннона как меры информации и возможной её неадекватности, и, следовательно, неадекватности энтропии фон Неймана как обобщения энтропии Шеннона.

Проведенный обзор (к сожалению, беглый, а порой и недостаточно математически строгий) эволюции научных взглядов на понятие энтропии позволяет дать ответы на важные вопросы, связанные с истинной сущностью энтропии и перспективами применения энтропийного подхода в научных и практических исследованиях. Ограничимся рассмотрением ответов на два таких вопроса.

Первый вопрос: имеют ли между собой многочисленные разновидности энтропии, как рассмотренные, так и не рассмотренные выше, что-нибудь общее кроме одинакового названия?

Этот вопрос возникает естественным образом, если принять во внимание то разнообразие, которое характеризует существующие различные представления об энтропии.

На сегодня научное сообщество не выработало единого, признанного всеми, ответа на этот вопрос: одни учёные отвечают на этот вопрос утвердительно, другие – отрицательно, третьи – относятся к общности энтропий различных видов с заметной долей сомнения.

Клаузиус, по-видимому, был первым учёным, убеждённым в универсальном характере энтропии и полагавшим, что во всех процессах, происходящих во Вселенной, она играет важную роль, в частности, определяя их направление развития во времени.

Кстати, именно Рудольфу Клаузиусу принадлежит одна из формулировок второго начала термодинамики: «Невозможен процесс, единственным результатом которого являлась бы передача тепла от более холодного тела к более горячему».

Эту формулировку второго начала термодинамики называют постулатом Клаузиуса, а необратимый процесс, о котором идёт речь в этом постулате, – процессом Клаузиуса.

Со времени открытия второго начала термодинамики необратимые процессы играли уникальную роль в физической картине мира. Так, знаменитая статья 1849 года Уильяма Томпсона, в которой приведена одна из первых формулировок второго начала термодинамики, называлась «Об универсальной тенденции в природе к диссипации механической энергии».

Отметим также, что и Клаузиус был вынужден использовать космологический язык: «Энтропия Вселенной стремится к максимуму».

бельгийско-американский физик и

химик российского происхождения,

лауреат Нобелевской премии

по химии 1977 года

К аналогичным выводам пришёл Илья Пригожин. Пригожин полагает, что принцип энтропии ответственен за необратимость времени во Вселенной и, возможно, играет важную роль в понимании смысла времени как физического феномена.

К настоящему времени выполнено множество исследований и обобщений энтропии, в том числе и с точки зрения строгой математической теории. Однако заметная активность математиков в этой области пока не востребована в приложениях, за исключением, пожалуй, работ Колмогорова, Реньи и Тсаллиса.

Несомненно, энтропия – это всегда мера (степень) хаоса, беспорядка. Именно разнообразие проявления феномена хаотичности и беспорядка обусловливает неизбежность разнообразия модификаций энтропии.

Второй вопрос: можно ли признать сферу применения энтропийного подхода обширной или все приложения энтропии и второго начала термодинамики ограничиваются самой термодинамикой и смежными направлениями физической науки?

История научного изучения энтропии свидетельствует, что энтропия – это научное явление, открытое в термодинамике, а затем успешно перекочевавшее в другие науки и, прежде всего, в теорию информации.

Несомненно, энтропия играет важную роль практически во всех областях современного естествознания: в теплофизике, в статистической физике, в физической и химической кинетике, в биофизике, астрофизике, космологии и теории информации.

Говоря о прикладной математике, нельзя не упомянуть приложения принципа максимума энтропии.

Как уже отмечалось, важными областями применения энтропии являются квантово-механические и релятивистские объекты. В квантовой физике и астрофизике такие применения энтропии представляют собой большой интерес.

Упомянем лишь один оригинальный результат термодинамики чёрных дыр: энтропия чёрной дыры равна четверти площади её поверхности (площади горизонта событий).

В космологии считается, что энтропия Вселенной равна числу квантов реликтового излучения, приходящихся на один нуклон.

Таким образом, сфера применения энтропийного подхода весьма обширна и включает в себя самые разнообразные отрасли знания, начиная с термодинамики, других направлений физической науки, информатики и заканчивая, например, историей и экономикой.

А.В. Сигал , доктор экономических наук, Крымский университет имени В.И. Вернадского

- http://studfiles.net/preview/5300769/

- http://www.krainaz.org/2016-04/153-entropy-04