Определить понятие «количество информации» довольно сложно. В решении этой проблемы существуют два основных подхода. Исторически они возникли почти одновременно. В конце 40-х годов XX века один из основоположников кибернетики американский математик Клод Шеннон развил вероятностный подход к измерению количества информации, а работы по созданию ЭВМ привели к «объемному» подходу.

Рассмотрим в качестве примера опыт, связанный с бросанием правильной игральной .кости, имеющей N граней (наиболее распространенным является случай шестигранной кости: N = 6). Результаты данного опыта могут быть следующие: выпадение грани с одним из следующих знаков: 1,2. N.

Введем в рассмотрение численную величину, измеряющую неопределенность —энтропию(обозначим ее Н). Величины N и Н связаны между собой некоторой функциональной зависимостью:

а сама функция fявляется возрастающей, неотрицательной и определенной (в рассматриваемом нами примере) для N = 1, 2. 6.

Рассмотрим процедуру бросания кости более подробно:

1) готовимся бросить кость; исход опыта неизвестен, т.е. имеется некоторая неопределенность; обозначим ее H1;

2) кость брошена; информация об исходе данного опыта получена; обозначим количество этой информации через I;

3) обозначим неопределенность данного опыта после его осуществления через H2. За количество информации, которое получено в ходе осуществления опыта, примем разность неопределенностей «до» и «после» опыта:

Очевидно, что в случае, когда получен конкретный результат, имевшаяся неопределенность снята (Н2= 0), и, таким образом, количество полученной информации совпадает с первоначальной энтропией. Иначе говоря, неопределенность, заключенная в опыте, совпадает с информацией об исходе этого опыта. Заметим, что значение Н2 могло быть и не равным нулю, например, в случае, когда в ходе опыта следующей выпала грань со значением, большим «З».

Следующим важным моментом является определение вида функции fв формуле (1.1). Если варьировать число гранейNи число бросаний кости (обозначим эту величину черезМ),общее число исходов (векторов длины М, состоящих из знаков 1,2. N)будет равноNв степениМ:

Так, в случае двух бросаний кости с шестью гранями имеем: Х= 6 2 = 36. Фактически каждый исходХесть некоторая пара(X1, X2),гдеX1иX2 —соответственно исходы первого и второго бросаний (общее число таких пар —X).

Ситуацию с бросанием Мраз кости можно рассматривать как некую сложную систему, состоящую из независимых друг от друга подсистем — «однократных бросаний кости». Энтропия такой системы вМраз больше, чем энтропия одной системы (так называемый «принцип аддитивности энтропии»):

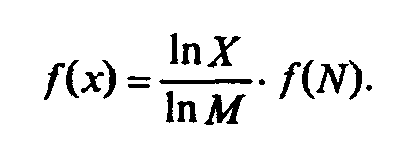

Данную формулу можно распространить и на случай любого N:

Прологарифмируем левую и правую части формулы (1.3): ln X = M ∙ ln N, М= ln X/1n M. Подставляем полученное дляMзначение в формулу (1.4):

Обозначив через Кположительную константу , получим:f(X) = К ∙ lп Х,или, с учетом (1.1), H=K ∙ ln N.Обычно принимаютК= 1 / ln 2. Таким образом

Это — формула Хартли.

Важным при введение какой-либо величины является вопрос о том, что принимать за единицу ее измерения. Очевидно, Нбудет равно единице приN = 2.Иначе говоря, в качестве единицы принимается количество информации, связанное с проведением опыта, состоящего в получении одного из двух равновероятных исходов (примером такого опыта может служить бросание монеты при котором возможны два исхода: «орел», «решка»). Такая единица количества информации называется «бит».

Все Nисходов рассмотренного выше опыта являются равновероятными и поэтому можно считать, что на «долю» каждого исхода приходится однаN-ячасть общей неопределенности опыта: (log2N)1N.При этом вероятностьi-го исходаРi равняется, очевидно, 1/N.

Та же формула (1.6) принимается за меру энтропии в случае, когда вероятности различных исходов опыта неравновероятны(т.е.Рiмогут быть различны). Формула (1.6) называется формулой Шеннона.

В качестве примера определим количество информации, связанное с появлением каждого символа в сообщениях, записанных на русском языке. Будем считать, что русский алфавит состоит из 33 букв и знака «пробел» для разделения слов. По формуле (1.5)

Однако, в словах русского языка (равно как и в словах других языков) различные буквы встречаются неодинаково часто. Ниже приведена табл. 1.3 вероятностей частоты употребления различных знаков русского алфавита, полученная на основе анализа очень больших по объему текстов.

Воспользуемся для подсчета Нформулой (1.6);Н ≈ 4,72 бит. Полученное значениеН,как и можно было предположить, меньше вычисленного ранее. ВеличинаН, вычисляемая по формуле (1.5), является максимальным количеством информации, которое могло бы приходиться на один знак.

Таблица 1.3. Частотность букв русского языка

Определение количества информации. Вероятностный подход. ЕГЭ

ЕГЭ Определениеколичестваинформации( ) вероятностный подход( ) вероятностный подход Урок2 Существует формула, которая связывает между собой количество возможных событийN и количество информацииI:N = 2I По этой формуле можно легко определить количество возможных событий, если известно количество информации.

Например, если мы получили4 бита информации, то количество возможных событий составлялоN = 24 =16 Наоборот, для определения количества информации, если известно количество событий, необходимо решить показательное уравнение относительноI.

Решение задач 1.

Определить количество информации, полученной вторым игроком после первого хода первого игрока, в игре «крестики-нолики» на поле размером 8х8 клеток.

Решение: Перед первым ходом существует64 возможных события (64 различных варианта расположения «крестика»), тогда уравнениеN = 2I принимает вид: 64 = 2I Так как 64 = 26 , то26 = 2I .

Таким образом,I =6 битов , т.е.

количество информации, полученной вторым игроком после первого хода первого игрока, составляет 6 битов.

В рулетке общее количество лунок равно 32.

Какое количество информации (с точки зрения вероятностного подхода) мы получаем в зрительном сообщении об остановке шарика в одной из лунок? 1) 8 битов 2) 5 битов 3) 2 бита 4) 1 бит Решение:N = 2I 32 = 2I т.к.

32=25 , то 25 = 2I, I = 5 Ответ: 5 битов 3.

Каково было количество возможных событий, если после реализации одного из них получено количество информации, равное 3 битам? Решение:N = 2IN = 23 8 = 23 N = 8 Ответ:84.

Световое табло состоит из лампочек.

Каждая лампочка может находиться в одном из трех состояний («включено», «выключено» или «мигает»).

Какое наименьшее количество лампочек должно находиться на табло, чтобы с его помощью можно было передать 18 различных сигналов? Решение: С помощью одной лампочки можно передать 3 сигнала, с помощью двух 32 = 9 сигналов, с помощью трех 33 = 27 сигналов.

Значит, чтобы подать 18 сигналов, нужно не менее трех лампочек.

Ответ:3 Другой способ: 3 состояния лампочки, 18 сигналовN = 3I , 18 = 3I , 27 = 3I = 33,I =3 Домашняя работа №2 (задания из ЕГЭ!) 1.

Производится бросание симметричной четырехгранной пирамидки.

Какое количество информации (с точки зрения вероятностного подхода) мы получаем в зрительном сообщении о ее падении на одну из граней? 1) 1 бит 2) 2 бита 3) 4 бита 4) 8 битов 2.

Какое количество информации (с точки зрения вероятностного подхода) получит второй игрок при игре в крестики-нолики на поле 4х4, после первого хода первого игрока, играющего крестиками? 1) 1 бит 2) 2 бита 3) 4 бита 4) 8 битов (10 задач) 3.

В рулетке общее количество лунок равно 128.

Какое количество информации мы получаем в зрительном сообщении об остановке шарика в одной из лунок? 1) 1 бит 2) 4 бита 3) 7 бит 4) 8 4.

Сколько различных последовательностей длиной в 7 символов можно составить из цифр 0 и 1? 5.

В корзине лежат 8 шаров.

Все шары разного цвета.

Сколько информации несет сообщение о том, что из корзины выкатился синий шар? 6.

Какое максимальное количество бит потребуется для кодирования целых положительных чисел меньших 60? 7.

Игровое клетчатое поле состоит из 15 строк и 5 столбцов.

Партия записана последовательностью из 10 координат, соответствующих ходам игроков по клеткам.

Какой объем информации в битах несет эта запись, если для кодирования координат одной клетки поля использовали двоичный код минимальной длины? 1) 50 2) 60 3) 70 4) 80 8.

В некоторой стране пользуются двоичной системой счисления.

Какое минимальное количество знаков потребуется для написания различных почтовых индексов для 718 городов? 9.

В кинотеатре 16 рядов по 32 места в каждом.

Какое количество информации в битах содержит сообщение о том, что продан один билет в 8-ом ряду место №4? 1) 5 2) 8 3) 9 4) 16 10.

Сколько существует различных вариантов составления

Какое количество информации (с точки зрения вероятностного подхода)получит при игре в шахматы играющий черными после первого хода белых (при

условии, что ходить пешками запрещено)?

Если пешками ходить запрещено, то можно ходить только конями. Коней два, каждый может сходить на одно из двух полей, следовательно имеются 4 варианта ходов. После того, как ход белых был сделан, неопределенность в знаниях черных уменьшилась в 4/1=4 раза. 4=2², поэтому полученное количество информации составляет 2 бита.

Другие вопросы из категории

Изменение какого параметра настройки сканирования значительно поменял размер файла? 1) Настройки сохранения местоположения файла; 2) Разрешение сканирования; 3) Изменение режима работы с автоматического на режим профессиональный; 4) Изменение режима «оттенки серого» на режим «цветное 48 бит».

При помощи функции trunc() в Паскале можно реализовать операции целочисленного деления и взятия остатка от деления. Например:

целочисленное деление — trunc(491/240) — результатом будет 2;

остаток от деления — 491-240*trunc(491/240) — результатом будет 11.

Используя функцию trunc(), напишите программу, считающую сдачу в английской денежной системе (в этой денежной системе 1 фунт стерлингов равен 20 шиллингам, а 1 шиллинг равен 12 пенсам). Напишите программу, в которой в трёх константах хранится стоимость товара. Одна константа — фунты (целое значение больше нуля), вторая — шиллинги (значение от 0 до 19), третья — пенсы (значение от 0 до 11). Ещё в трёх таких же константах хранится плата покупателя. Используя одну целочисленную переменную, программа должна сосчитать и вывести на экран сдачу в фунтах, шиллингах и пенсах. НЕ ИСПОЛЬЗОВАТЬ УСЛОВНЫЙ ОПЕРАТОР

ПРОГРАММА ДОЛЖНА БЫТЬ НАПИСАНА НА ПАСКАЛЕ АВС

( символы записываются в обратной последовательности.)

2.Дана символьная строка. Слово — последовательность символов между пробелами, не содержащая пробелы внутри себя.составить программу, в которой выводились бы все слова, в которых есть заданный символ.

Вероятностный подход к определению количества информации «Формула Шеннона. Применение ЭТ Excel для решения задач на нахождение количества информации»

Материал разработан на 2 спаренных урока.

Цели уроков: Сформировать у учащихся понимание вероятности, равновероятных событий и событий с различными вероятностями. Научить находить количество информации, используя вероятностный подход. Создать в Excel информационную модель для автоматизации процесса вычислений в задачах на нахождение количества информации, используя формулу Шеннона.

Требования к знаниям и умениям:

Учащиеся должны знать:

- какие события являются равновероятными, какие неравновероятными;

- как найти вероятность события;

- как найти количество информации в сообщении, что произошло одно из неравновероятных событий;

- как найти количество информации в сообщении, когда возможные события имеют различные вероятности реализации.

Учащиеся должны уметь:

- различать равновероятные и неравновероятные события;

- находить количество информации в сообщении, что произошло одно из равновероятных событий или одно из не равновероятных событий;

- создать информационную модель для автоматизации процесса решения задач на нахождение количества информации с помощью прикладных программ.

Оборудование: доска, компьютер, мультимедийный проектор, карточки с заданиями, карточки-памятки, справочный материал.

Урок 1. Вероятностный подход к определению количества информации. Формула Шеннона

Ход урока

I. Организационный момент.

II. Проверка домашнего задания.

III. Постановка цели урока.

Задача: Какое сообщение содержит большее количество информации?

- В библиотеке 8 шкафов. Книга нашлась в 3-м шкафу; (Отв.: 3 бит.)

- Вася получил за экзамен оценку 4 (по 5-бальной системе единицы не ставят). (Отв.: 2 бит.)

- Бабушка испекла 12 пирожков с капустой, 12 пирожков с повидлом. Маша съела один пирожок. (Отв.: 1 бит.)

- Бабушка испекла 8 пирожков с капустой, 16 пирожков с повидлом. Маша съела один пирожок.

Первые три варианта учащиеся решают без затруднения. События равновероятны, поэтому можно применить для решения формулу Хартли. Но третье задание вызывает затруднение. Делаются различные предположения. Роль учителя: подвести учащихся к осмыслению, что в четвертом варианте мы сталкиваемся с ситуацией, когда события неравновероятны. Не все ситуации имеют одинаковые вероятности реализации. Существует много таких ситуаций, у которых вероятности реализации различаются. Например, если бросают несимметричную монету или «правило бутерброда».

Сегодня на уроке мы должны ответить на вопрос: как вычислить количество информации в сообщении о неравновероятном событии.

IV. Объяснение нового материала.

Для вычисления количества информации в сообщении о неравновероятном событии используют следующую формулу: I=log2(1/p)

где I – это количество информации, р – вероятность события.

Вероятность события выражается в долях единицы и вычисляется по формуле: р=K/N,

где К – величина, показывающая сколько раз произошло интересующее нас событие, N – общее число возможных исходов какого-то процесса.

Вернемся к нашей задаче.

Пусть К1 – это количество пирожков с повидлом, К1=24

К2 – количество пирожков с капустой, К2=8

N – общее количество пирожков, N = К1 +К2=24+8=32

Вычислим вероятность выбора пирожка с разной начинкой и количество информации, которое при этом было получено.

Вероятность выбора пирожка с повидлом: р1=24/32=3/4=0,75.

Вероятность выбора пирожка с капустой: р2=8/32=1/4=0,25.

Обращаем внимание учащихся на то, что в сумме все вероятности дают 1.

Вычислим количество информации, содержащееся в сообщении, что Маша выбрала пирожок с повидлом: I1=log2(1/p1)= log2(1/0,75)= log21,3=1,15470 бит.

Вычислим количество информации, содержащееся в сообщении, если был выбран пирожок с капустой: I2=log2(1/p2)= log2(1/0,25)= log24=2 бит.

Пояснение: если учащиеся не умеют вычислять значение логарифмической функции, то можно использовать при решении задач этого урока следующие приемы:

- Ответы давать примерные, задавая ученикам следующий вопрос: «В какую степень необходимо возвести число 2, чтобы получилось число, стоящее под знаком логарифма?».

- Применить таблицу из задачника-практикума под редакцией Семакина И.Г. и др.

Приложение 1. «Количество информации в сообщении об одном из N равновероятных событий: I= log2N». (Приложение вы можете получить у автора статьи.)

При сравнении результатов вычислений получается следующая ситуация: вероятность выбора пирожка с повидлом больше, чем с капустой, а информации при этом получилось меньше. Это не случайность, а закономерность.

Качественную связь между вероятностью события и количеством информации в сообщении об этом событии можно выразить так: чем меньше вероятность некоторого события, тем больше информации содержит сообщение об этом событии.

Вернемся к нашей задаче с пирожками. Мы еще не ответили на вопрос: сколько получим информации при выборе пирожка любого вида?

Ответить на этот вопрос нам поможет формула вычисления количества информации для событий с различными вероятностями, которую предложил в 1948 г. американский инженер и математик К.Шеннон.

Если I-количество информации, N-количество возможных событий, рi — вероятности отдельных событий, где i принимает значения от 1 до N, то количество информации для событий с различными вероятностями можно определить по формуле:

можно расписать формулу в таком виде:

Рассмотрим формулу на нашем примере:

Теперь мы с вами можем ответить на вопрос задачи, которая была поставлена в начале урока. Какое сообщение содержит большее количество информации?

- В библиотеке 8 шкафов. Книга нашлась в 3-м шкафу; (Отв.: 3 бит.)

- Вася получил за экзамен 3 балла (по 5-бальной системе единицы не ставят). (Отв.: 2 бит.)

- Бабушка испекла 12 пирожков с капустой, 12 пирожков с повидлом. Маша съела один пирожок. (Отв.: 1 бит.)

- Бабушка испекла 8 пирожков с капустой, 16 пирожков с повидлом. Маша съела один пирожок. (Отв.: 0,815 бит.)

Ответ: в 1 сообщении.

Обратите внимание на 3 и 4 задачу. Сравните количество информации.

Мы видим, что количество информации достигает максимального значения, если события равновероятны.

Интересно, что рассматриваемые нами формулы классической теории информации первоначально были разработаны для технических систем связи, призванных служить обмену информацией между людьми. Работа этих систем определяется законами физики т.е. законами материального мира. Задача оптимизации работы таких систем требовала, прежде всего, решить вопрос о количестве информации, передаваемой по каналам связи. Поэтому вполне естественно, что первые шаги в этом направлении сделали сотрудники Bell Telephon Companie – X. Найквист, Р. Хартли и К. Шеннон. Приведенные формулы послужили К. Шеннону основанием для исчисления пропускной способности каналов связи и энтропии источников сообщений, для улучшения методов кодирования и декодирования сообщений, для выбора помехоустойчивых кодов, а также для решения ряда других задач, связанных с оптимизацией работы технических систем связи. Совокупность этих представлений, названная К. Шенноном “математической теорией связи”, и явилась основой классической теории информации. (Дополнительный материал можно найти на сайте http://polbu.ru/korogodin_information или прочитав книгу В.И. Корогодин, В.Л. Корогодина. Информация как основа жизни. Формула Шеннона.)

Можно ли применить формулу К. Шеннона для равновероятных событий?

Мы видим, что формула Хартли является частным случаем формулы Шеннона.

V. Закрепление изучаемого материала.

Задача: В корзине лежат 32 клубка красной и черной шерсти. Среди них 4 клубка красной шерсти.

Сколько информации несет сообщение, что достали клубок красной шерсти? Сколько информации несет сообщение, что достали клубок шерсти любой окраски?

Дано: Кк=4;N=32

Найти: Iк, I

Решение:

- Найдем количество клубков черной шерсти: Кч=N- Кк; Кч=32-4=28

- Найдем вероятность доставания клубка каждого вида: pк= Кк/N=4/32=1/8; pч= Кч/N=28/32=7/8;

- Найдем количество информации, которое несет сообщение, что достали клубок красной шерсти: Iк= log2(1/(1/ pк))= log2(1/1/8)= log28=3 бит

- Найдем количество информации, которое несет сообщение, что достали клубок шерсти любой окраски:

VI. Подведение итогов урока.

- Объясните на конкретных примерах отличие равновероятного события от неравновероятного?

- С помощью какой формулы вычисляется вероятность события.

- Объясните качественную связь между вероятностью события и количеством информации в сообщении об этом событии.

- В каких случаях применяется формула Шеннона для измерения количества информации.

- В каком случае количество информации о событии достигает максимального значения.

Урок 2. Применение ЭТ Excel для решения задач на нахождение количества информации

Пояснение: При решении задач на нахождение количества информации учащиеся не вычисляли значение логарифма, т.к. не знакомы с логарифмической функцией. Урок строился таким образом: сначала решались однотипные задачи с составлением формул, затем разрабатывалась табличная модель в Excel, где учащиеся делали вычисления. В конце урока озвучивались ответы к задачам.

Ход урока

I. Постановка целей урока

На этом уроке мы будем решать задачи на нахождение количества информации в сообщении о неравновероятных событиях и автоматизируем процесс вычисления задач данного типа.

Для решения задач на нахождение вероятности и количества информации используем формулы, которые вывели на прошлом уроке:

рi=Ki/N; Ii=log2(1/pi);

II. Решение задач.

Ученикам дается список задач, которые они должны решить.

Задачи решаются только с выводами формул, без вычислений.

В озере обитает 12500 окуней, 25000 пескарей, а карасей и щук по 6250. Какое количество информации несет сообщение о ловле рыбы каждого вида. Сколько информации мы получим, когда поймаем какую-нибудь рыбу?

Решение:

- Найдем общее количество рыбы: N= Ко+Кп+Кк+Кщ.

- Найдем вероятность ловли каждого вида рыбы: pо= Ко/N;pп= Кп/N;pк=pщ= Кк/N.

- Найдем количество информации о ловле рыбы каждого вида: Iо=log2( 1/pо);Iп=log2(1/pп);Iк=Iщ=log2(1/pк)

- Найдем количество информации о ловле рыбы любого вида: I=pо∙log2pо+pп∙log2pп+pк∙log2pк+pщ∙log2pщ

III. Объяснение нового материала.

Задается вопрос ученикам:

1. Какие трудности возникают при решении задач данного типа? (Отв.: Вычисление логарифмов).

2. Нельзя ли автоматизировать процесс решения данных задач? (Отв.: можно, т.к. алгоритм вычислений в этих задачах один и тот же).

3. Какие программы используются для автоматизации вычислительного процесса? (Отв.: ЭТ Excel).

Давайте попробуем сделать табличную модель для вычисления задач данного типа.

Нам необходимо решить вопрос, что мы будем вычислять в таблице. Если вы внимательно присмотритесь к задачам, то увидите, что в одних задачах надо вычислить только вероятность событий, в других количество информации о происходящих событиях или вообще количество информации о событии.

Мы сделаем универсальную таблицу, где достаточно занести данные задачи, а вычисление результатов будет происходить автоматически.

Структура таблицы обсуждается с учениками. Роль учителя обобщить ответы учащихся.

При составлении таблицы мы должны учитывать:

- Ввод данных (что дано в условии).

- Подсчет общего количества числа возможных исходов (формула N=K1+K2+…+Ki).

- Подсчет вероятности каждого события (формула pi= Кi/N).

- Подсчет количества информации о каждом происходящем событии (формула Ii= log2(1/pi)).

- Подсчет количества информации для событий с различными вероятностями (формула Шеннона).

Прежде чем демонстрировать заполнение таблицы, учитель повторяет правила ввода формул, функций, операцию копирования (домашнее задание к этому уроку).

При заполнении таблицы показывает как вводить логарифмическую функцию. Для экономии времени учитель демонстрирует уже готовую таблицу, а ученикам раздает карточки-памятки по заполнению таблицы.

Рассмотрим заполнение таблицы на примере задачи №1.

Рис. 1. Режим отображения формул

Рис. 2. Отображение результатов вычислений

Результаты вычислений занести в тетрадь.

Если в решаемых задачах количество событий больше или меньше, то можно добавить или удалить строчки в таблице.

VI. Практическая работа.

1. Сделать табличную модель для вычисления количества информации.

2. Используя табличную модель, сделать вычисления к задаче №2 (рис.3), результат вычисления занести в тетрадь.

3. Используя таблицу-шаблон, решить задачи №3,4 (рис.4, рис.5), решение оформить в тетради.

4. Сохранить таблицы в своих папках под именем «инф_вероятность».

В классе 30 человек. За контрольную работу по информатике получено 15 пятерок, 6 четверок, 8 троек и 1 двойка. Какое количество информации несет сообщение о том, что Андреев получил пятерку?

В коробке лежат кубики: 10 красных, 8 зеленых, 5 желтых, 12 синих. Вычислите вероятность доставания кубика каждого цвета и количество информации, которое при этом будет получено.

В непрозрачном мешочке хранятся 10 белых, 20 красных, 30 синих и 40 зеленых шариков. Какое количество информации будет содержать зрительное сообщение о цвете вынутого шарика?

VII. Подведение итогов урока.

Учитель оценивает работу каждого ученика. Оценивается не только практическая работа на компьютере, но и оформление решения задачи в тетради.

VIII. Домашняя работа.

1. Параграф учебника «Формула Шеннона», компьютерный практикум после параграфа.

2. Доказать, что формула Хартли – частный случай формулы Шеннона.

Литература:

- Соколова О.Л. «Универсальные поурочные разработки по информатике. 10-й класс.» – М.: ВАКО, 2007.

- Угринович Н.Д. «Информатика и ИКТ. Профильный уровень. 10 класс» — Бином, Лаборатория знаний, 2007 г.

- Семакин И.Г., Хеннер Е.К. «Информатика. Задачник – практикум.» 1 том, — Бином, Лаборатория знаний, 2008 г.

Какое количество информации с точки зрения вероятностного подхода

Урок « Вероятностный подход к определению количества информации «.

Количество информации в случае различных вероятностей событий определяется

по формуле Шеннона:

где Pi – вероятность i -го события,

N – количество возможных событий

Формула была предложена в 1948 г.

а мериканский учёный,

(30 апреля 1916 — 24 февраля 2001 )

Существует множество ситуаций, когда возможные события имеют различные вероятности реализации. Рассмотрим примеры таких событий.

1. При случайном падении бутерброда вероятность падения его маслом вниз (более тяжёлой стороной) больше, чем маслом вверх.

2. В коробке 20 карандашей, из них 15 красных и 5 чёрных. Вероятность вытащить наугад красный карандаш больше, чем чёрный.

Количество информации в сообщении о некотором событии зависит от его вероятности. Чем меньше вероятность события, тем больше информации оно несёт.

P = K / N , где К – количество случаев реализации одного из исходов события, N – общее число возможных исходов одного из событий 2 i = log 2(1/ p ), где i – количество информации, p – вероятность события

Задача 1. В коробке 50 шаров, из них 40 белых и 10 чёрных. Определить количество информации в сообщении о вытаскивании наугад белого шара и чёрного шара.

Решение: Вероятность вытаскивания белого шара — P 1 = 40/50 = 0,8

Вероятность вытаскивания чёрного шара P 2 = 10/50 = 0,2

Количество информации о вытаскивании белого шара i 1 = log 2(1/0,8) = log 21,25

= log 1,25/ log 2 » 0,32 бит

Количество информации о вытаскивании чёрного шара i2 = log2(1/0,2) = log25 = log5/log2 » 2,32 бит

Ответ: 0,32 бит; 2,32 бит

Задача 2. В озере живут караси и окуни. Подсчитано, что карасей 1500, а окуней — 500. Сколько информации содержится в сообщениях о том, что рыбак поймал карася, окуня, поймал рыбу?

Решение: События поимки карася или окуня не являются равновероятными, так как окуней в озере меньше, чем карасей.

Общее количество карасей и окуней в пруду 1500 + 500 = 2000.

Вероятность попадания на удочку карася

p 1 = 1500/2000 = 0,75, окуня p 2 – 500/2000 = 0,25.

I 1 = log 2(1/ p 1), I 1 = log 2(1/ p 2), где I 1 и I 2 – вероятности поймать карася и окуня соответственно.

I 1 = log 2(1 / 0,75) » 0,43 бит, I 2 = log 2(1 / 0,25) » 2 бит – количество информации в сообщении поймать карася и поймать окуня соответственно.

Количество информации в сообщении поймать рыбу (карася или окуня) рассчитывается по формуле Шеннона

I = — 0,75*log20,75 — 0,25*log20,25 = — 0,75*(log0,75/log2)-0,25*(log0,25/log2) = 0,604 бит » 0.6 бит.

Ответ: в сообщении содержится 0,6 бит информации

Вычисление количества информации для равновероятных событий

определяется по формуле Хартли:

Формула Хартли — частный случай формулы Шеннона

для равновероятных событий:

где N – число возможных событий,

i – количество информации в битах.

Формула была предложена Р. Хартли в 1928 г.

Ральф Хартли

30 ноября 1888 г — 1 мая 1970 г

Задача 1. В коробке 32 карандаша, все карандаши разного цвета. Наугад вытащили красный. Какое количество информации при этом было получено?

Решение: Так как вытаскивание карандаша любого цвета из имеющихся в коробке 32 карандашей является равновероятным, то число возможных событий равно 32.

N = 32, i = ? N = 2 i , 32 = 25, i = 5 бит .

Задача 2. В школьной библиотеке 16 стеллажей с книгами, на каждом – по 8 полок. Ученику сообщили, что нужный учебник находится на 2-ой полке 4-го стеллажа. Какое количество информации получил ученик?

1) Число стеллажей (случаев) – 16.

N 1 = 16, N 1 = 2 I , 16 = 2 I , 16 = 24, I 1= 4 бита.

2) Число полок на каждом стеллаже (случаев) – 8,

N2 = 8, N2 = 2I, 8 = 23, I2 = 3 бит .

3) i = i1 + i2, i = 4 бита + 3 бита = 7 бит .

Задача 3. Загадывают число в диапазоне от 1 до 200. Какое наименьшее количество вопросов надо задать, чтобы наверняка отгадать число. На вопросы можно отвечать только «Да» или «Нет».

Решение: Правильная стратегия состоит в том, чтобы количество вариантов каждый раз уменьшалось вдвое.

Например, загадано число 152.

1 вопрос: Число >100? Да.

3 вопрос: Число > 175? Нет. и т.д.

Количество событий в каждом варианте будет одинаково, и их отгадывание равновероятно. N = Ii , 200 = 2 i , 7 i

Измерение информации

Содержательный подход

С позиции содержательного подхода к измерению информации решается вопрос о количестве информации в сообщении, получаемом человеком. Рассматривается следующая ситуация:

1) человек получает сообщение о некотором событии; при этом заранее известна неопределенность знания человека об ожидаемом событии. Неопределенность знания может быть выражена либо числом возможных вариантов события, либо вероятностью ожидаемых вариантов события;

2) в результате получения сообщения неопределенность знания снимается: из некоторого возможного количества вариантов оказался выбранным один;

3) по формуле вычисляется количество информации в полученном сообщении, выраженное в битах.

Формула, используемая для вычисления количества информации, зависит от ситуаций, которых может быть две:

1. Все возможные варианты события равновероятны. Их число конечно и равно N.

2. Вероятности (p) возможных вариантов события разные и они заранее известны:

i>, i = 1..N. Здесь по-прежнему N — число возможных вариантов события.

Равновероятные события. Если обозначить буквой i количество информации в сообщении о том, что произошло одно из N равновероятных событий, то величины i и N связаны между собой формулой Хартли:

Величина i измеряется в битах. Отсюда следует вывод:

1 бит — это количество информации в сообщении об одном из двух равновероятных событий.

Формула Хартли — это показательное уравнение. Если i — неизвестная величина, то решением уравнения (1) будет:

Формулы (1) и (2) тождественны друг другу. Иногда в литературе формулой Хартли называют (2).

Пример 1. Сколько информации содержит сообщение о том, что из колоды карт достали даму пик?

В колоде 32 карты. В перемешанной колоде выпадение любой карты — равновероятные события. Если i — количество информации в сообщении о том, что выпала конкретная карта (например, дама пик), то из уравнения Хартли:

Отсюда: i = 5 бит.

Пример 2. Сколько информации содержит сообщение о выпадении грани с числом 3 на шестигранном игральном кубике?

Считая выпадение любой грани событием равновероятным, запишем формулу Хартли: 2 i = 6. Отсюда: i = log26 = 2,58496 бит.

Неравновероятные события (вероятностный подход)

Если вероятность некоторого события равна p, а i (бит) — это количество информации в сообщении о том, что произошло это событие, то данные величины связаны между собой формулой:

Решая показательное уравнение (3) относительно i, получаем:

Формула (4) была предложена К.Шенноном, поэтому ее называют формулой Шеннона.

Методические рекомендации

Обсуждение связи между количеством информации в сообщении и его содержанием может происходить на разных уровнях глубины.

Качественный подход

Качественный подход, который может использоваться на уровне пропедевтики базового курса информатики (5–7-е классы) или в базовом курсе (8–9-е классы).

На данном уровне изучения обсуждается следующая цепочка понятий: информация — сообщение — информативность сообщения.

Исходная посылка: информация — это знания людей, получаемые ими из различных сообщений. Следующий вопрос: что такое сообщение? Сообщение — это информационный поток (поток данных), который в процессе передачи информации поступает к принимающему его субъекту. Сообщение — это и речь, которую мы слушаем (радиосообщение, объяснение учителя), и воспринимаемые нами зрительные образы (фильм по телевизору, сигнал светофора), и текст книги, которую мы читаем, и т.д.

Вопрос об информативности сообщения следует обсуждать на примерах, предлагаемых учителем и учениками. Правило: информативным назовем сообщение, которое пополняет знания человека, т.е. несет для него информацию. Для разных людей одно и то же сообщение с точки зрения его информативности может быть разным. Если сведения “старые”, т.е. человек это уже знает, или содержание сообщения непонятно человеку, то для него это сообщение неинформативно. Информативно то сообщение, которое содержит новые и понятные сведения.

Примеры неинформативных сообщений для ученика 8-го класса:

1)“Столица Франции — Париж” (не новое);

2) “Коллоидная химия изучает дисперсионные состояния систем, обладающих высокой степенью раздробленности” (не понятное).

Пример информативного сообщения (для тех, кто этого не знал): “Эйфелева башня имеет высоту 300 метров и вес 9000 тонн”.

Введение понятия “информативность сообщения” является первым подходом к изучению вопроса об измерении информации в рамках содержательной концепции. Если сообщение неинформативно для человека, то количество информации в нем, с точки зрения этого человека, равно нулю. Количество информации в информативном сообщении больше нуля.

Количественный подход в приближении равновероятности

Данный подход может изучаться либо в углубленном варианте базового курса в основной школе, либо при изучении информатики в 10–11-х классах на базовом уровне.

Рассматривается следующая цепочка понятий: равновероятные события — неопределенность знаний — бит как единица измерения информации — формула Хартли — решение показательного уравнения для N равного целым степеням двойки.

Раскрывая понятие равновероятности, следует отталкиваться от интуитивного представления детей, подкрепив его примерами. События равновероятны, если ни одно из них не имеет преимущества перед другими.

Введя частное определение бита, которое было дано выше, затем его следует обобщить:

Сообщение, уменьшающее неопределенность знаний в 2 раза, несет 1 бит информации.

Это определение подкрепляется примерами сообщений об одном событии из четырех (2 бита), из восьми (3 бита) и т.д.

На данном уровне можно не обсуждать варианты значений N, не равные целым степеням двойки, чтобы не сталкиваться с проблемой вычисления логарифмов, которые в курсе математики пока не изучались. Если же у детей будут возникать вопросы, например: “Сколько информации несет сообщение о результате бросания шестигранного кубика”, — то объяснение можно построить следующим образом. Из уравнения Хартли: 2 i = 6. Поскольку 2 2 3 , следовательно, 2 i = 1/1 = 1. Отсюда, i = 0 бит.

Формула Хартли (1) является частным случаем формулы (3). Если имеется N равновероятных событий (результат бросания монеты, игрального кубика и т.п.), то вероятность каждого возможного варианта равна p = 1/N. Подставив в (3), снова получим формулу Хартли: 2 i = N. Если бы в примере 3 автобусы № 5 и № 7 приходили бы к остановке из 100 раз каждый по 50, то вероятность появления каждого из них была бы равна 1/2. Следовательно, количество информации в сообщении о приходе каждого автобуса равно i = log22 = 1 биту. Пришли к известному варианту информативности сообщения об одном из двух равновероятных событий.

Пример 4. Рассмотрим другой вариант задачи об автобусах. На остановке останавливаются автобусы № 5 и № 7. Сообщение о том, что к остановке подошел автобус № 5, несет 4 бита информации. Вероятность появления на остановке автобуса с № 7 в два раза меньше, чем вероятность появления автобуса № 5. Сколько бит информации несет сообщение о появлении на остановке автобуса № 7?

Запишем условие задачи в следующем виде:

Вспомним связь между вероятностью и количеством информации: 2 i = 1/p

Подставляя в равенство из условия задачи, получим:

Из полученного результата следует вывод: уменьшение вероятности события в 2 раза увеличивает информативность сообщения о нем на 1 бит. Очевидно и обратное правило: увеличение вероятности события в 2 раза уменьшает информативность сообщения о нем на 1 бит. Зная эти правила, предыдущую задачу можно было решить “в уме”.

Вероятностный и алфавитный подходы к измерению информации. Единицы измерения информации

Различные подходы к измерению количества информации в сообщении определяются различием подходов к определению самого понятия «информация».

Чтобы измерить что-либо, необходимо ввести единицу измерения. Минимальная единица измерения информации — бит. Смысл данной единицы также различен в рамках разных подходов к измерению информации.

Выделяют три подхода.

1. Неизмеримость информации в быту

Если в сообщении содержалось для вас что-то новое, то оно информативно. Но для другого человека в этом же сообщении нет ничего нового, для него оно не информативно. Это происходит оттого, что до получения данного сообщения знания каждого из нас были различны. Фактор субъективного восприятия сообщения делает невозможным количественную оценку информации в сообщении, т. е. если рассматривать количество полученной информации с точки зрения новизны для получателя, то измерить её невозможно.

2. Вероятностный, или содержательный подход

Попытаться объяснить данный подход можно, допустив,

что для каждого человека можно условно выделить (например, в виде окружности) область его знания. Всё, что будет находиться за пределами окружности, можно назвать информационной неопределенностью. Постепенно, в процессе обучения или иной деятельности происходит переход от незнания к знанию, т. е. неопределенность уменьшается. Именно такой подход к информации как мере уменьшения неопределенности знания позволяет ее количественно оценить (измерить).

Сообщение, уменьшающее неопределенность знания в 2 раза, несет один бит информации.

Например: при подбрасывании монеты может выпасть либо «орел», либо «решка». Это два возможных события. Они равновероятны. Сообщение о том, что произошло одно из двух равновероятных событий (например, выпала «решка»), уменьшает неопределенность нашего знания (перед броском монеты) в два раза.

Математики рассматривают идеальный вариант, что возможные события равновероятны. Если даже события неравновероятны, то возможен подсчет вероятности выпадения каждого события.

Под неопределенностью знания здесь понимают количество возможных событий, их может быть больше, чем два.

Например, количество оценок, которые может получить студент на экзамене, равно четырем. Сколько информации содержится в сообщении о том, что он получил «4»? Рассуждая, с опорой на приведенное выше определение, можем сказать, что если сообщение об одном из двух возможных событий несет 1 бит информации, то выбор одного из четырех возможных событии несет 2 бита информации. Можно прийти к такому выводу, пользуясь методом половинного деления. Сколько вопросов необходимо задать, чтобы выяснить необходимое, столько битов и содержит сообщение. Вопросы должны быть сформулированы так, чтобы на них можно было ответить «да» или «нет», тогда каждый из них будет уменьшать количество возможных событий в 2 раза.

Это формула Р. Хартли. Если р = 1/N — вероятность наступления каждого из N равновероятных событий, тогда формула Хартли записывается так:

i = log2(1/p) = log2p

Чтобы пользоваться рассмотренным подходом, необходимо вникать в содержание сообщения. Это не позволяет использовать данный подход для кодирования и передачи информации с помощью технических устройств.

3. Алфавитный подход к измерению информации

Подход основан на подсчете числа символов в сообщении. Этот подход не связывает количество информации с содержанием сообщения, позволяет реализовать передачу, хранение и обработку информации с помощью технических устройств, не теряя при этом содержания (смысла) сообщения.

Алфавит любого языка включает в себя конечный набор символов. Исходя из вероятностного подхода к определению количества информации, появление символов алфавита в тексте можно рассматривать как различные возможные события. Количество таких событий (символов) N называют мощностью алфавита. Тогда количество информации (, которое несет каждый из N символов, согласно вероятностному подходу определяется из формулы:

Количество символов в тексте из k символов:

Алфавитный подход является объективным способом измерения информации и используется в технических устройствах.

Переход к более крупным единицам измерения

Ограничения на максимальную мощность алфавита не существует, но есть алфавит, который можно считать достаточным (на современном этапе) для работы с информацией, как для человека, так и для технических устройств. Он включает в себя: латинский алфавит, алфавит языка страны, числа, спецсимволы — всего около 200 знаков. По приведенной выше таблице можно сделать вывод, что 7 битов информации недостаточно, требуется 8 битов, чтобы закодировать любой символ такого алфавита, 256 = 28. 8 бит образуют 1 байт. То есть для кодирования символа компьютерного алфавита используется 1 байт. Укрупнение единиц измерения информации аналогично применяемому в физике — используют приставки «кило», «мега», «гига». При этом следует помнить, что основание не 10, а 2.

1 Кб (килобайт) = 210 байт = 1024 байт,

1 Мб(мегабайт) = 210 Кб = 220 байт и т. д.

Умение оценивать количество информации в сообщении поможет определить скорость информационного потока по каналам связи. Максимальную скорость передачи информации по каналу связи называют пропускной способностью канала связи. Самым совершенным средством связи на сегодня являются оптические световоды. Информация передается в виде световых импульсов, посылаемых лазерным излучателем. У этих средств связи высокая помехоустойчивость и пропускная способность более 100Мбит/с.

studopedia.org — Студопедия.Орг — 2014-2019 год. Студопедия не является автором материалов, которые размещены. Но предоставляет возможность бесплатного использования (0.001 с) .

- http://en.ppt-online.org/2452

- http://informatika.neznaka.ru/answer/3977382_kakoe-kolicestvo-informacii-s-tocki-zrenia-veroatnostnogo-podhodapolucit-pri-igre-v-sahmaty-igrausij-cernymi-posle-pervogo-hoda-belyh-pri/

- http://xn--i1abbnckbmcl9fb.xn--p1ai/%D1%81%D1%82%D0%B0%D1%82%D1%8C%D0%B8/574162/

- http://informatika.edusite.ru/lezione10_07i.htm

- http://xn----7sbbfb7a7aej.xn--p1ai/informatika_kabinet/inf_prozes/inf_prozes_06.html

- http://studopedia.org/6-62192.html